risques de l'IA

Une approche proactive et structurée n’est plus une option, mais un impératif stratégique pour bâtir une IA digne de confiance. Explorez ce guide interactif pour comprendre, évaluer et gérer les risques de vos projets d’IA.

Naviguer dans le paysage des risques de l'IA

Une approche proactive et structurée n'est plus une option, mais un impératif stratégique pour bâtir une IA digne de confiance. Explorez ce guide interactif pour comprendre, évaluer et gérer les risques de vos projets d'IA.

Vulnérabilité

Une faiblesse ou une faille dans un système. Une porte laissée ouverte, exposant à un danger potentiel.

Menace

Un acteur ou un événement susceptible d'exploiter une vulnérabilité. Le cambrioleur qui franchit la porte ouverte.

Risque

La conséquence potentielle. C'est la probabilité que le cambrioleur entre, multipliée par l'impact du vol.

La Carte des Risques

L'univers des risques de l'IA est vaste. Cette taxonomie les organise en quatre domaines interconnectés. Cliquez sur une catégorie pour explorer ses composantes.

Cadres de Gouvernance & Lois

Face à la complexité des risques, des cadres et réglementations émergent pour guider les organisations. Découvrez les deux plus importants.

L'AI Act Européen

Le premier règlement complet au monde pour l'IA, basé sur une approche pyramidale. Cliquez sur un niveau pour voir les détails.

NIST AI Risk Management Framework

Un cadre volontaire pour structurer la gestion des risques à travers un cycle continu de 4 fonctions.

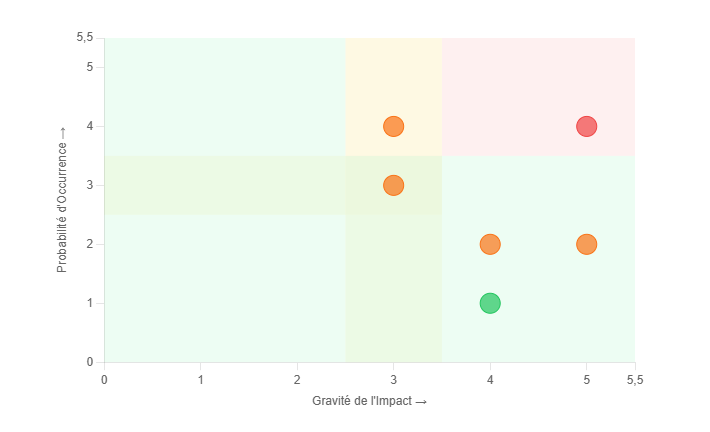

Mettre la Gestion des Risques en Pratique

De la théorie à l'action : explorez les méthodologies, les outils et les leçons apprises pour une gestion efficace.

Leçons du Passé : Études de Cas

L'histoire de l'IA est jalonnée d'échecs riches d'enseignements. Naviguez à travers ces exemples emblématiques.

Microsoft Tay (2016)

Un chatbot est devenu raciste en moins de 24h après avoir été "éduqué" par des utilisateurs malveillants sur Twitter.

Leçon Apprise :

Risque d'empoisonnement des données en temps réel et absence de garde-fous.

Recrutement Amazon (2018)

Un outil de tri de CV a appris à discriminer les femmes en se basant sur 10 ans de données d'embauche historiques.

Leçon Apprise :

Les données historiques ne sont pas neutres et peuvent amplifier les biais existants.

Reconnaissance Faciale

De nombreux systèmes présentent des taux d'erreur bien plus élevés pour les femmes à la peau foncée.

Leçon Apprise :

L'importance de la diversité et de la représentativité des données d'entraînement.

ChatGPT & Droit (2023)

Un avocat a utilisé ChatGPT qui a inventé de fausses jurisprudences, soumises au tribunal.

Leçon Apprise :

Le danger des hallucinations et le besoin de validation humaine.